Algorithmen außer Kontrolle

Der Handel mit persönlichen Daten zerstört Existenzen. Ein Plädoyer für strikte Regulierung

von Frank Pasquale

Ein Datenhändler hat das Leben von Catherine Taylor aus dem US-Bundesstaat Arizona auf den Kopf gestellt. Das Unternehmen ChoicePoint, eine der vielen tausend Firmen, die Konsumentendaten sammeln und verkaufen, verzeichnete fälschlich eine Strafanzeige wegen „Herstellung von Methamphetaminen mit Verkaufsabsicht“ in Taylors Datendossier. Das digitale Stigma verfolgte Taylor, wenn sie sich um Jobs bewarb, und schreckte Arbeitgeber ab. Sie erhielt nicht einmal mehr einen Kredit für eine neue Waschmaschine.

ChoicePoint korrigierte zwar den Fehler, nachdem die Firma darauf hingewiesen worden war, aber viele andere Unternehmen, an die ChoicePoint Taylors Daten weiterverkauft hatte, taten dies nicht. Catherine Taylor zog schließlich sogar vor Gericht. Die unkontrolliert herumschwirrenden falschen Daten raubten ihr die Nerven. „Ich kann doch nicht dauernd den Wachhund spielen“, klagte sie gegenüber dem Reporter der Washington Post, der über ihre Geschichte berichtete.1 Nachdem die Fehlinformation aufgetaucht war, dauerte es über vier Jahre, bis Taylor einen Job fand, aber eine neue Wohnung bekam sie nicht. Schließlich zog sie ins Haus ihrer Schwester. Der ganze Stress habe ihre Herzprobleme verschlimmert, sagt sie.

Auf eine Catherine Taylor, die immerhin wusste, dass ihre Daten sie verleumdeten, kommen Tausende, die keine Ahnung davon haben, dass sie digitalem Stalking und Profiling ausgesetzt sind. Dieselben Firmen, die ausgeklügelte Algorithmen verwenden, um zu überwachen und zu manipulieren, berufen sich auf das Geschäftsgeheimnis, wenn sie Auskunft geben sollen.

Journalisten und Whistleblower ermöglichen dennoch immer wieder Einblicke in die Blackbox der neuen Digitalwirtschaft. Ihnen sind die schockierenden Enthüllungen über Facebook und Cambridge Analytica zu verdanken, die weltweit die Aufmerksamkeit auf den Umgang mit Daten gelenkt haben.

Die Politiker, die an neuen Datenschutzgesetzen arbeiten – oder zumindest daran, vorhandene Bestimmungen besser durchzusetzen –, brauchen aber auch eine mentale Orientierungshilfe, wenn sie mit den riesigen Dateninfrastrukturen konfrontiert sind. Beim Gang durch dieses Labyrinth ist es hilfreich, sich zunächst grundsätzlich vor Augen zu führen, dass die Firmen personenbezogene Daten sammeln, diese analysieren, um Schlüsse zu ziehen, und schließlich die Analysen verwenden, wenn sie Entscheidungen fällen müssen. Dabei wirft jede dieser Etappen spezifische Probleme auf.

Wenn Bürgerinnen und Bürger Einsicht erhalten in die digitalen Dossiers, die Google und Facebook über sie angelegt haben, erleben sie unangenehme Überraschungen: Sie stoßen dann nämlich auf viele Stunden Videomaterial, intime Chats und Bilder, die sie vermeintlich schon lange gelöscht haben, die aber vollständig und dauerhaft in Archiven gespeichert sind. Auch minutiöse Bewegungsprofile tauchen auf. Über Smartphones mit dem Betriebssystem Android hat Google zudem klammheimlich Anruferdaten gesammelt. Da die Sensoren von Mobiltelefonen immer besser werden, könnten die Internetkonzerne versucht sein, immer noch mehr Informationen zu fischen. Am Ende steht ein lückenloses Profil, das die wunden Punkte, Wünsche, Schwächen und womöglich dunklen Geheimnisse der betreffenden Person enthüllt.

Für Firmen ist es ein Leichtes, Listen mit Menschen zu erstellen, die ständig Diät halten oder die „neurotisch“ oder „hilfsbedürftig“ sind. Der Vizepräsident eines Unternehmens aus der Gesundheitsbranche sagte einmal: „Anhand von Kreditkartendaten, der Angabe darüber, was für ein Auto jemand fährt, und von noch ein paar anderen Hinweisen zum Lebensstil ergibt sich für uns eine sehr genaue Vorstellung davon, ob die betreffende Person das Krankheitsbild hat, nach dem wir suchen.“2

Üblicherweise erfährt die Öffentlichkeit von dieser Datensammelei nur dann, wenn Unternehmen unbeabsichtigt etwas preisgeben. Eine US-Firma schickte einmal aus Versehen ein Schreiben an „Mike Seay, Tochter gestorben bei einem Autounfall“. Seays Tochter war tatsächlich knapp ein Jahr zuvor bei einem Autounfall ums Leben gekommen. Warum aber diese Information für Werbetreibende von Interesse sein soll, bleibt der Fantasie überlassen. Das Unternehmen sagt jedenfalls nichts dazu. Es gibt auch nicht preis, woher es die Information hat. Datenhändler können ihre Kunden vertraglich verpflichten, sie nicht als Quelle zu nennen.

Datensammler, -analytiker und -händler verhökern manchmal nur harmlose Informationen, zugleich aber haben sie auch ein gänzlich neues Niveau erreicht, wenn es um das Aufstellen zynischer Klassifizierungen geht. So wurden Listen von Menschen erstellt, die Opfer sexueller Übergriffe geworden sind oder von anderen willentlich mit sexuell übertragbaren Krankheiten angesteckt wurden. Es gibt Listen von Menschen mit Alzheimer, Demenz und Aids, Listen von Impotenten und Depressiven. Diese werden üblicherweise für ein paar Cent pro Name verkauft – meistens an Werbetreibende, zunehmend aber auch an Finanzinstitute, die potenzielle Kunden durchleuchten wollen, und Arbeitgeber, die mehr über Stellenbewerber erfahren wollen.

Je weiter die Privatsphäre der Einzelnen schrumpft, desto verschwiegener werden auch diese zwielichtigen Meister der industriellen Datensammlung und Datenauswertung. Der Staat sollte daher verlangen, dass Unternehmen offenlegen müssen, was sie über Personen speichern. Er sollte den Einzelnen auch die Möglichkeit geben, den Firmen die Sammlung nur bestimmter Daten zu untersagen, anstatt lediglich Alles-oder-nichts-Vereinbarungen vorzuschreiben. Nutzer wollen beispielsweise vielleicht nicht, dass Facebook eine vollständige Übersicht über ihre Krankenhausaufenthalte besitzt. Facebook an der Sammlung solcher sensiblen Informationen zu hindern, würde das Vertrauen der Nutzer stärken.

Die Aufsichtsbehörden sind bereits dabei, sich ein Bild von diesen Praktiken zu machen; doch der Handel mit Gesundheitsdaten ist schwer zu überblicken, da Millionen digitaler Akten verschlüsselt und per Mausklick verschickt werden. Vielleicht lassen sich Spuren von Datenverkäufen finden, aber was, wenn die Transaktionen per Handschlag abgewickelt werden? Für die Behörden ist es schon schwer, Unternehmen in der analogen Welt zu kontrollieren; die Ausbreitung von Datenfirmen überfordert sie vollends. Solange diese nicht verpflichtet sind, zu dokumentieren, woher ihre Daten stammen und wohin diese gehen, kann man sich weder einen Eindruck vom Umfang des Datenmissbrauchs verschaffen noch gegen illegale Transfers vorgehen.

Der Gesetzgeber sollte verbieten, dass bestimmte Informationen ohne ausdrückliche Erlaubnis weitergegeben werden, und dieses Verbot auch durchsetzen. Ein positives Beispiel in dieser Hinsicht ist die Praxis in vielen US-Bundesstaaten, in denen Arbeitgeber Beschäftigte und Bewerber nicht nach den Passwörtern für ihre Konten in sozialen Netzwerken fragen dürfen. Aber was, wenn Jobsuchende die Passwörter freiwillig preisgeben, weil sie sich davon einen Vorteil gegenüber Mitbewerbern erhoffen? Dann bleiben all jene auf der Strecke, denen ihre Privatsphäre wichtig ist, weil die Unternehmen womöglich Anwärter bevorzugen, die unbegrenzt Einblicke in alle Bereiche ihres digitalen Lebens gewähren, unabhängig davon, wie die Rechtslage aussieht.

Das Sammeln von Informationen steht allerdings nur am Beginn des gesamten Datenschutzproblems. Firmen analysieren nämlich die Daten auch und ziehen Schlüsse aus diesen Analysen. Die Soziologin Mary Ebeling beispielsweise hatte am Anfang einer Schwangerschaft, die mit einer Fehlgeburt endete, online ein paar Formulare ausgefüllt. Während sie noch trauerte, bombardierten Unternehmen sie mit Werbung für Babyprodukte. In zahllosen, nicht nachvollziehbaren Datenbanken war sie als junge Mutter registriert. Sie schrieb ein Buch darüber, wie sie versuchte herauszufinden, wie ihre Privatsphäre in Sachen Gesundheit verletzt worden war – aber es gelang ihr nicht, dem Ursprung der Werbesendungen und Anzeigen auf den Grund zu gehen, die sie noch Jahre nach der Fehlgeburt erreichten.3

Wieder andere Algorithmen entscheiden über den Ruf von Personen als Kreditnehmer, Studierende, Mieter und Beschäftigte. Viele Kreditvermittler im Netz arbeiten heute mit Daten, die bisher nicht bei der Vergabe von Darlehen an Konsumenten und Kleinunternehmen verwendet wurden. Ein Bericht von Privacy International zeigte kürzlich, dass Finanzdienstleister, die digitale Technologien einsetzen – sogenannte Fintechs –, bei der Bewertung der Kreditwürdigkeit eines Kunden bereits folgende Faktoren berücksichtigen: politische Aktivitäten, Telefongespräche und Chats, von dem Kunden auf dem Smartphone installierte Apps, Standortdaten und ausgefüllte Formulare.4

Außerdem entwickeln selbstlernende Systeme immer weitergehende Methoden, um die Kreditwürdigkeit oder Faktoren, die diese beeinflussen, zu bewerten. In einem kürzlich veröffentlichen Paper wird behauptet, dass es möglich sei, allein aus den Gesichtszügen einer Person auf ihre Neigung zu Kriminalität zu schließen.5 Forscher, die sich mit maschinellem Lernen beschäftigen, treffen mittlerweile auch Aussagen über die sexuelle Orientierung und Gesundheit einer Person allein anhand ihres Porträtfotos – und ein solches ist über Google oder Facebook leicht zu beschaffen.6

Maschinelles Lernen ist eine wertvolle Innovation im Kampf gegen Krebs oder gegen Hackerangriffe, in anderen Bereichen aber hat diese Technologie oft negative Folgen für die Menschen. Es ist dokumentiert, dass es unter den Kreditkartengesellschaften mindestens eine gibt, die sich für seelische Erkrankungen und bestimmte Lebensereignisse interessiert, etwa dafür, ob jemand zur Eheberatung geht. Sagt nun die Statistik, dass Leute, die so etwas tun, sich mit größerer Wahrscheinlichkeit scheiden lassen als andere Paare, wird die Inanspruchnahme der Hilfe als ein Zeichen dafür interpretiert, dass aus einer ehelichen demnächst eine finanzielle Krise werden könnte. Das läuft faktisch auf eine Bestrafung für die Inanspruchnahme einer Eheberatung hinaus. Wenn diese Kalkulation verschwiegen wird, bleiben die Kreditkarteninhaber über einen wichtigen Aspekt ihrer Kreditwürdigkeit im Unklaren. Wird sie aber offengelegt, könnte das Paare davon abhalten, eine Eheberatungsstelle aufzusuchen, obwohl dies dringend nötig wäre, um die Beziehung zu retten.

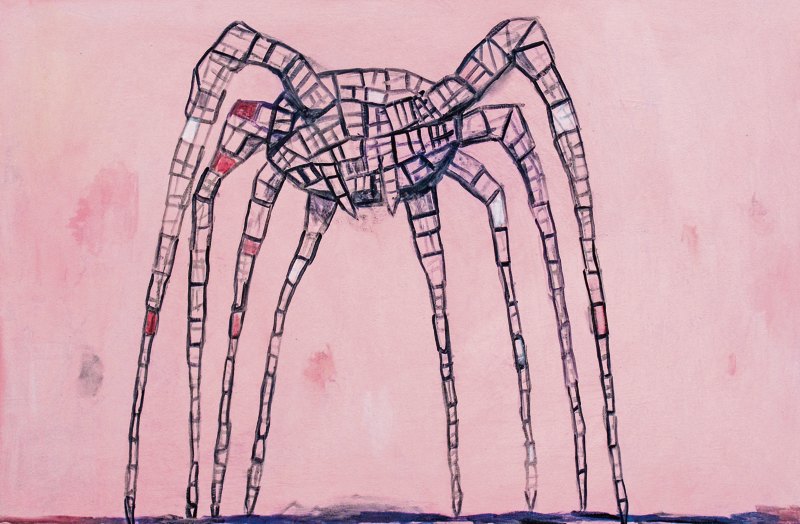

Tatsächlich muss der kausale Zusammenhang zwischen Eheberatung und Zahlungsverzögerung gar nicht belegt sein; eine Korrelation reicht schon, um Dinge in Gang zu setzen. Außer Kontrolle geratene Daten können eine ganze Reihe von Benachteiligungen zur Folge haben, weil die digitale Alchemie neue analoge Realitäten schafft. Wenn ein Stück Software erst einmal entschieden hat, dass jemand ein Kreditrisiko darstellt, bei der Arbeit faul oder als Konsument uninteressant ist, kann sich das für sie oder ihn in allen möglichen Bereichen nachteilig auswirken.

Manche Rückschlüsse sollten verboten werden. Zum Beispiel lassen sich Standortdaten gut mit bestimmten ethnischen Gruppen in Beziehung setzen. Wenn aber die Kreditwürdigkeit einer Person ganz oder teilweise davon abhängt, ob sie womöglich in einer „schlechten Wohngegend“ lebt, kommt dies der Zuweisung einer ethnischen Zugehörigkeit und der Verweigerung eines Kredits aufgrund dieser Zugehörigkeit gleich.

Während das Leben der meisten Bürger der Kontrolle durch den Staat unterliegt, verbergen große Unternehmen ihre Daten und Algorithmen vor den Behörden, die uns vermeintlich schützen. Warum sollte vom Staat nicht verlangt werden, mehr zu tun, um Verstöße dieser Unternehmen aufzudecken? Google und Facebook haben bereits ein umfangreiches Sündenregister. Sie sollten viel strenger überwacht und kontrolliert werden. Die technischen und rechtlichen Möglichkeiten dafür existieren. Weltweit haben die Nachrichtendienste im Namen des „Kriegs gegen den Terror“ ihre Überwachung verschärft. Ein Krieg gegen Verletzungen der Privatsphäre und gegen Datenmissbrauch wäre die passende neue Aufgabe für sie.

Die Behörden müssen selbstlernende Systeme zumindest so weit kontrollieren, dass sie erkennen, ob die Unternehmen sich von Daten aus dubiosen Quellen beeinflussen lassen. Manche Unternehmen im Bereich der Finanztechnologie, die mit künstlicher Intelligenz arbeiten, werden vielleicht entgegnen, dass der Einsatz von Computern bei Entscheidungsprozessen zu Ergebnissen führt, die ebenso schwer zu erklären sind wie die Entscheidungen eines Menschen. Aber es gilt, misstrauisch zu bleiben gegenüber der Behauptung, dass maschinelles Lernen „unendlich komplex“ sei und sich dem menschlichen Verständnis entziehe; dahinter verbirgt sich nämlich meist schlicht der Wunsch nach Deregulierung. Zudem kann die künstliche Intelligenz, für die sich kommerzielle Organisationen begeistern, sich durchaus auch als künstliche Dummheit erweisen.

Die staatliche Aufsicht könnte Informationen darüber verlangen, welche Daten in ein besonders komplexes System für die Bewertung der Kreditwürdigkeit eingeflossen sind, und beispielsweise die Verwendung von gesundheitsbezogenen Angaben untersagen. Nach der Datenschutz-Grundverordnung der EU (DSGVO), die am 25. Mai in Kraft tritt, haben die Bürgerinnen und Bürger das Recht, zu erfahren, welche Logik Entscheidungsvorgängen zugrunde liegt, wenn Urteile über sie ausschließlich durch automatisierte Prozesse gefällt werden.

Dieses „Recht auf Erklärung“ sollte ein weltweites Menschenrecht werden. Um das Vertrauen der Öffentlichkeit in demokratische Entscheidungsprozesse wiederherzustellen, sollten die Behörden rasch die Freigabe der Daten verlangen, die bei einer persönlichen Ansprache anhand von Algorithmen verwendet werden, welche Algorithmen zum Einsatz kommen und worauf sich die Ansprache richtet. Wenden betroffene Firmen ein, dass ihre Algorithmen zu vielschichtig seien, um sie offenzulegen, sollten die gewählten Entscheidungsträger in diesem Fall eine zielgruppenorientierte Aufbereitung und Verwendung von Informationen verbieten.

Längst werden Risiken mittels automatisierter Prozesse bewertet

Ein Staat kann wohl kaum Forschern verbieten, dass sie anhand von Gesichtsmerkmalen Aussagen über die Kreditwürdigkeit einer Person oder deren Neigung zu kriminellem Verhalten treffen. Es kann allerdings untersagt werden, dass Gesichtserkennung bei der Kreditvergabe eine Rolle spielt oder dass Colleges sich bei ihren Zulassungsentscheidungen unter anderem auf den Punktwert für das „Störpotenzial“ berufen, den ein Bewerber schon als Kleinkind bekommen hat.

Angenommen, im Bereich der Informationen, die für die eigene Reputation relevant sind, würde völlige Transparenz herrschen: Alle Menschen könnten sämtliche über sie gesammelten Daten von der Quelle über den Datenhändler bis zum Endverbraucher verfolgen; sie könnten Einspruch erheben, wenn sie bestimmte Daten für fehlerhaft oder diffamierend halten; wenn sie wollten, könnten sie sogar unterschiedliche digitale Profile pflegen und dafür sorgen, dass jeder Datenhändler die aktuellste und für sie vorteilhafteste Version ihrer Vorlieben, Interessen und Leistungen besitzt. Würde das tatsächlich die Bedenken gegenüber der neuen Reputationswirtschaft zerstreuen?

Wahrscheinlich nicht. Erstens wird es, je mehr Daten verwendet werden, für die einzelnen Personen immer schwieriger – auch mit neuester Software und professioneller Hilfe – im Auge zu behalten, wo und wie die Informationen dargestellt werden. Zweitens können selbst korrekte, wahre Angaben in vielen Zusammenhängen unfair oder diskriminierend eingesetzt werden.

Nehmen wir zum Beispiel jenes Kreditkartenunternehmen, das Zahlungen für eine Eheberatung als Hinweis auf einen möglichen Zahlungsausfall interpretiert und für den Inhaber der Karte den Zinssatz entsprechend anhebt. Professionelle Hilfe zu suchen, darf die Entscheidung über Kreditbedingungen nicht beeinflussen. Verboten ist bereits die Verwendung genetischer Informationen bei Einstellungsentscheidungen, weil Menschen sich nicht aussuchen können, mit welchem Erbgut sie geboren werden. Doch verhält es sich bei vielen häufigen Krankheiten nicht ganz genauso – von Krebs über Angstzustände bis hin zu Depressionen, die mit einer kriselnden Beziehung einhergehen können? Krankheit darf bei Kreditentscheidungen keine Rolle spielen.

Die Aufgabe, Probleme bei der Verwendung großer Datenmengen zu entdecken, darf nicht auf den Einzelnen abgewälzt werden. Nur sehr wenige haben die Zeit, tausende Datenbanken zu durchforsten, die womöglich Einfluss auf ihr Leben nehmen. Das sollte vielmehr Aufgabe der Behörden sein; diese sollten die Datenbestände großer Firmen und kommerzieller Datenhändler auf verdächtige Daten hin kontrollieren und nach deren Herkunft fragen, um so sicherzustellen, dass sie aus verlässlichen Quellen stammen. Mit Blick auf das Gesundheitswesen hat die US-Regierung bereits Verträge mit Überwachungsexperten geschlossen, die einen problematischen Umgang mit Patientenangaben in Krankenhäusern und Arztpraxen aufdecken sollen. Teile der Datenindustrie könnten besteuert werden, um damit die Kosten für die Kontrolle zu decken.

Unternehmen nutzen immer häufiger automatisierte Prozesse, um Risiken zu bewerten und Chancen zu identifizieren. Die Firmen, die diese Prozesse beherrschen, gehören zu den dynamischsten, profitabelsten und wichtigsten Akteuren der Informationsökonomie. Sie verwenden Algorithmen, meistens im Geheimen, um riesige Berge von Informationen zu ordnen. Die Verführungskraft der Technologie liegt auf der Hand: Der uralte Wunsch, die Zukunft vorherzusagen, mischt sich hier mit einem Schuss statistischer Nüchternheit.

Doch in einem Klima der Geheimniskrämerei werden sich negative Informationen genauso hartnäckig halten wie positive – und zu ungerechten oder womöglich sogar katastrophalen Voraussagen führen. Die Modellbildung wird umso nachteiliger, je stärker ungerechte oder unangemessene Erwägungen mit der Macht der Algorithmen zusammenwirken und damit die Störungen überhaupt erst erzeugen, die angeblich nur vorhergesagt werden sollen.

Um heutzutage ein informierter Staatsbürger zu sein, reicht es nicht aus, zu verstehen, wie der Staat funktioniert. Es erfordert auch, zu begreifen, dass und wie Datenunternehmen unseren Staat und unsere Kultur beeinflussen. Allen Versprechungen von Freiheit und Selbstbestimmung zum Trotz, die wir von den Herren des Informationszeitalters immer wieder hören, können ihre Blackbox-Methoden ebenso eine digitale Aristokratie entstehen lassen wie Meritokraten stärken.

Deshalb ist Datengerechtigkeit so wichtig. Ohne strikte Regulierung der Sammlung, Analyse und Verwendung von Informationen sind noch mehr Skandale wie der um Facebook und Cambridge Analytica zu erwarten. Forderungen nach Achtung der Würde des Einzelnen und nach sozialer Gerechtigkeit sind umstritten: Es wird immer Menschen geben, die lieber an überkommenen Privilegien festhalten wollen. Aber für die Bürger ist es an der Zeit, zu verlangen, dass wichtige Entscheidungen über die Finanz- und Kommunikationsinfrastruktur unabhängigen Kontrolleuren offengelegt werden – und dass sie in den kommenden Jahren Bestandteile einer öffentlichen Akte werden, die jeder und jede einsehen kann.

Aus dem Englischen von Ursel Schäfer

Frank Pasquale ist Juraprofessor an der Universität Maryland, USA, und Autor von „Black Box Society. The Secret Algorithms that Control Money and Information“, Cambridge (Harvard University Press) 2015.

Von wegen Fortschritt

Nach dem US-Wahlkampf von 2008 schwärmten die Kommentatoren von den innovativen Methoden des jungen Kandidaten: „Daten machen Wahlen intelligenter“ (Sasha Issenberg), „Daten geben der Politik ihre Seele zurück“ (Joe Trippi), „Big Data wird die Politik retten“ (MIT Technology Review). Obamas Wahlkampfteam soll alle seine 69 456 897 Fans, die ihn ins Weiße Haus gewählt hatten, namentlich gekannt haben. Vier Jahre später gingen die Helfer noch weiter und machten es wie die Onlinewerber: Um potenzielle Wählerinnen und Wähler mit maßgeschneiderten Botschaften zu erreichen, durchkämmten sie Facebook und speicherten alle Informationen in einer gigantischen Datenbank ab. Alles ging gut: Eine gebildete, kultivierte und fortschrittliche Persönlichkeit blieb an der Spitze der Supermacht.

Auch in Hillary Clintons Wahlkampf arbeiteten 2016 hunderte Datenexperten mit Facebook zusammen. Befürchtungen, die User könnten sich dagegen wehren, dass ihre Daten zu politischen Zwecken ausgebeutet werden, gab es anscheinend nicht. Die Konsumenten seien an zielgerichtete Werbung gewöhnt, hieß es. Und dass Donald Trump kein Chance hätte, weil die Demokraten die Daten viel intelligenter zu nutzen wüssten. Alles würde gut gehen: Wer die besseren Daten hat, wird gewinnen.

Doch dann besiegte im November 2016 ein Basecap-Slogan („Make America Great Again“) die ausgeklügelten Algorithmen aus Kalifornien. Von da an ging alles schief. Clintons Anhänger wollten nicht zugeben, dass sie an einer Wählerschaft und einem Kandidaten gescheitert waren, die sie gleichermaßen verachteten, und machten für ihre Niederlage genau die Methoden verantwortlich, die ihnen eigentlich zum Sieg hätten verhelfen sollen. Das Problem war nur, dass diese Methoden von dunklen Mächten benutzt wurden, wie den Russen, die sich in den sozialen Netzwerken tummelten und dort politische Werbung und Fake News verbreiteten, und dem Unternehmen Cambridge Analytica, das für Donald Trump persönliche Daten von Facebook-Usern gesammelt und ausgewertet hatte. Was für ein Skandal! Auf einmal zeigte der von Datenextraktion angetriebene Überwachungskapitalismus, wie er funktionierte, und wurde vom „Retter des politischen Lebens“ zu einer „Gefahr für die Demokratie“.

Datensammelei und Datenauswertung galten lange als Nebenprodukte eines prinzipiell wohlgelittenen Systems. Nun waren sie auf einmal das Geschäftsmodell von Plattformen, die ihre Dienste nur anboten, um dann Kundendaten an Werbetreibende zu verkaufen. Wem ist die Verbreitung von Fake News anzulasten, dem diabolischen Genie „der Russen“ oder dem Algorithmus von Facebook, das wie eine digitale Klatschzeitschrift die Aufmerksamkeit seiner User fesselt und so dafür sorgt, dass Informationen sich verbreiten?

Mark Zuckerberg wird uns darauf keine Antwort geben. Als der Facebook-Gründer nach dem Cambridge-Analytica-Skandal Anfang April zur Anhörung vor dem US-Kongress erschien, ging es ihm offensichtlich nur darum, das angekratzte Image seines Unternehmens wiederaufzupolieren. ⇥Pierre Rimbert